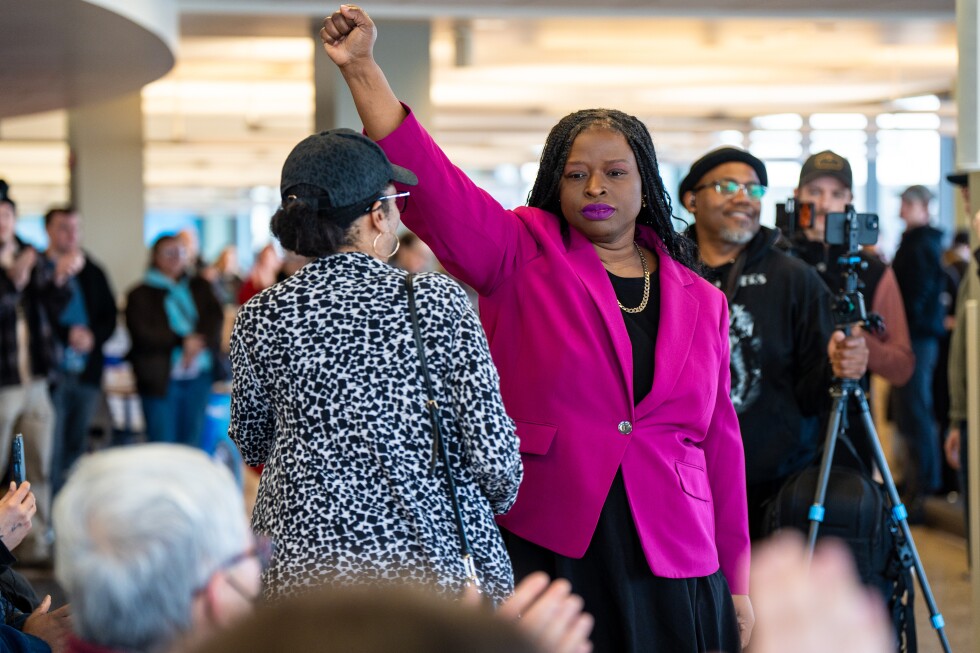

La Casa Blanca, bajo la administración Trump, ha adoptado abiertamente la imaginería generada por inteligencia artificial, desde caricaturas políticas hasta memes difundidos a través de canales oficiales. Sin embargo, el reciente uso de una imagen alterada y notablemente realista de la abogada de derechos civiles Nekima Levy Armstrong, supuestamente llorando tras ser detenida, ha marcado un punto de inflexión preocupante, según analistas.

El incidente escaló cuando la cuenta del Secretario de Seguridad Nacional, Kristi Noem, publicó la imagen original del arresto, seguida por la versión alterada en las redes oficiales de la Casa Blanca. Este contenido sintético forma parte de una oleada de imágenes editadas que circulan en el espectro político, especialmente tras incidentes de alta tensión como los tiroteos fatales por parte de agentes de la Patrulla Fronteriza.

Ante las críticas, funcionarios de la Casa Blanca redoblaron su postura, con el director adjunto de comunicaciones, Kaelan Dorr, afirmando que los "memes continuarán". David Rand, profesor de ciencias de la información en la Universidad de Cornell, interpreta esta defensa como un intento deliberado de enmascarar la manipulación mediática bajo el paraguas de lo humorístico. Rand señala que el propósito de compartir la imagen alterada de Levy Armstrong es mucho más ambiguo que el de las caricaturas previas, buscando quizás un impacto emocional más profundo.

Zach Henry, consultor de comunicaciones republicano, explica que estas imágenes hiperrealistas sirven para movilizar a la base más conectada digitalmente, que reconoce el formato de meme, mientras que para audiencias menos expertas, el realismo fotográfico genera preguntas y reacciones intensas. Para Henry, cualquier reacción fuerte es un catalizador para la viralidad, independientemente de la veracidad del contenido.

Michael A. Spikes, profesor de la Universidad Northwestern e investigador de alfabetización mediática, subraya la gravedad de que fuentes gubernamentales consoliden narrativas mediante la creación de contenido sintético. "El gobierno debería ser un lugar donde se pueda confiar en la información... Al compartir este tipo de contenido, se erosiona esa confianza fundamental en la capacidad del gobierno federal para ofrecer información precisa y verificada", advierte Spikes, temiendo que esto exacerbe las crisis institucionales existentes en torno a los medios y la educación.

La proliferación de videos y fotos generados por IA sobre temas sensibles, como las redadas de inmigración y las interacciones con ICE, ya está saturando el ecosistema digital. Jeremy Carrasco, creador de contenido enfocado en desmentir videos virales de IA, observa que gran parte de este material es 'engagement farming', buscando clics mediante palabras clave populares, aunque algunos usuarios lo consumen como "fan fiction" o "deseo cumplido". La dificultad para el espectador promedio de discernir lo real de lo sintético, incluso ante errores evidentes como texto ilegible en señales de tráfico, es el desafío central.

La solución a largo plazo, según expertos como Carrasco, podría residir en la adopción generalizada de sistemas de marca de agua digital que incrusten la procedencia del contenido en los metadatos. Sin embargo, la implementación de estándares como los promovidos por la Coalición para la Procedencia y Autenticidad del Contenido (C2PA) se ve lejana. Como concluye Carrasco, la manipulación mediática asistida por IA es ahora un problema permanente que la sociedad apenas comienza a comprender en su magnitud.

Fuente: Adaptado de Associated Press (AP)